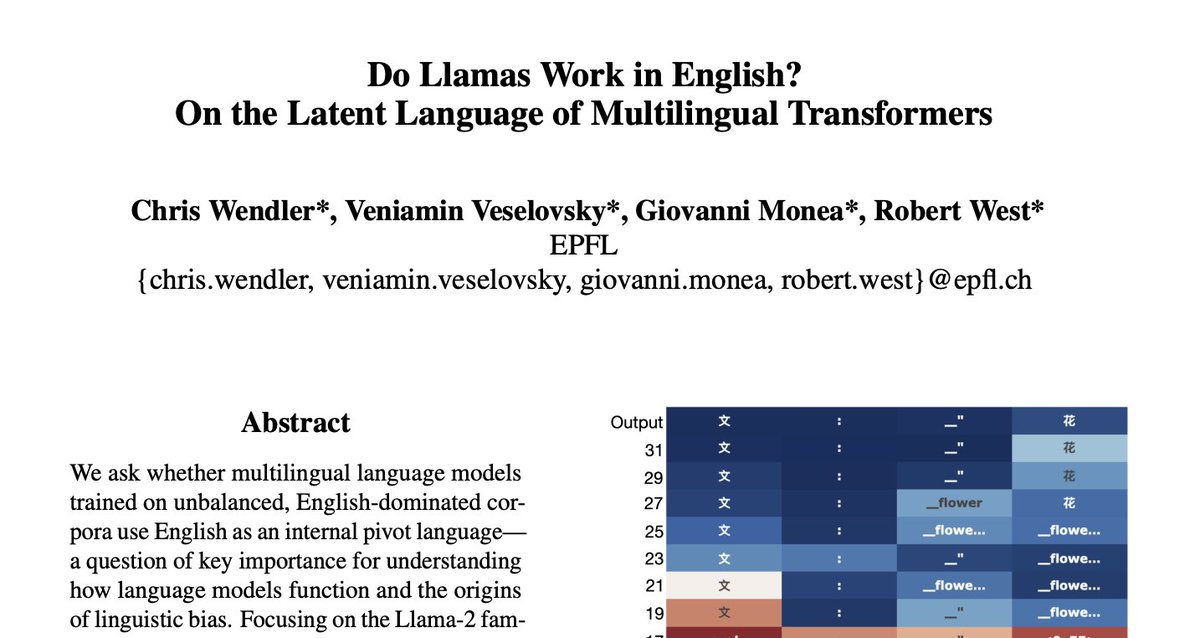

#llm_native_language نتائج البحث

最近1年半ぐらいの賢いLLMでは、もはや「プロンプトエンジニアリング」って頑張らなくてもそこそこのタスクは問題なくこなせて、それが難しい場合って実は「そもそも日本語のテキストコミュニケーションスキルの課題」なのではという気がしてたけど、同僚とも認識一致した

シンプルに国産LLMといったら、LLM-jpやSarashina、PLaMoとかそういうのが連想されるけど、思った以上にたくさんあった… (っていうかllm-jpのアウトリーチ活動、素晴らしすぎませんか…?外部の私でも有難い情報にたくさんアクセスできる) github.com/llm-jp/awesome…

LLMのプロンプトエンジニアリングガイドによると、LLMの性能は学習ソースに近いほどあがるので、英語以外の性能はおもちゃなので性能を引き出したければ英語以外使うなとあります。 日本語で満足してしまっている場合、おもちゃレベルで満足してしまってる可能性があります

ChatGPTもほぼ英日マスターしてるし、ネイティブの日本語使った方がたぶん細かいニュアンスとか言い回しとかもしっかり伝わるくらいにAI賢いと思うけどなあ

【ブログ】翻訳特化型LLM「PLaMo翻訳」を公開し、Webから無料で使えるようにしました。従来手法と異なり翻訳ではない文章を主に学習し、広い知識・流暢さを獲得しています。特化型LLMのポテンシャル、PLaMoの強みがわかると思います。 是非普段づかいも含め、お試しください。 tech.preferred.jp/ja/blog/plamo-…

claude团队揭秘:ai大脑不用英文也不用中文思考,而是靠“思维语言”。|这证明了英语学习/教育失败的根本原因? llm用什么语言“思考”?中文?英文? 都不是。…

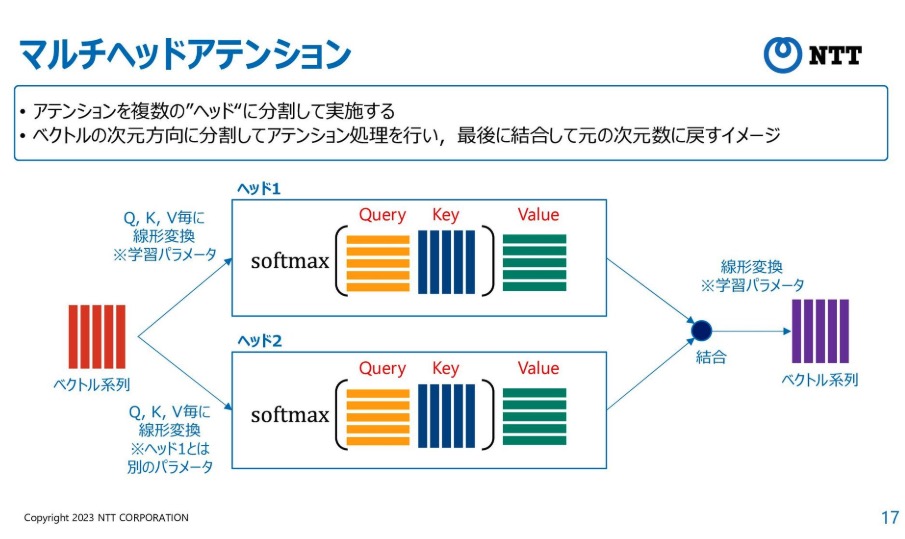

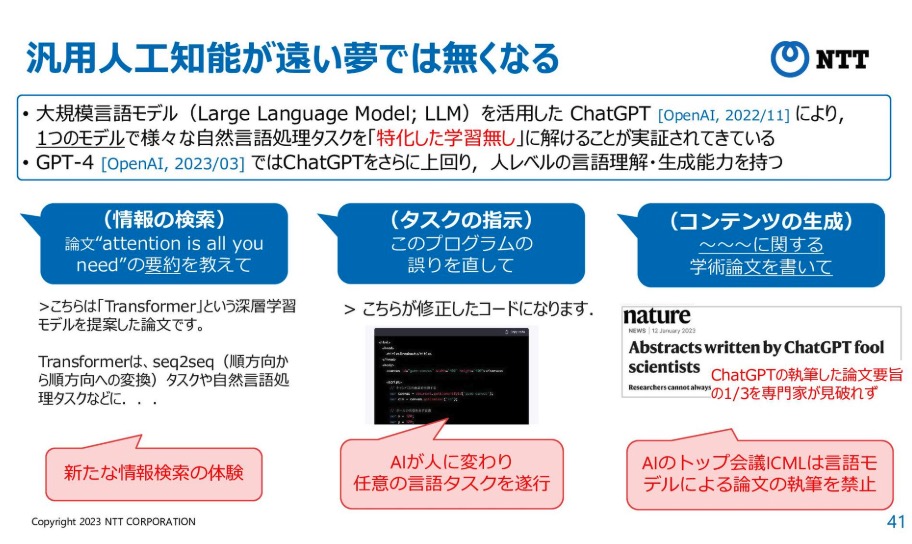

NTTが公開した「大規模言語モデル入門」の資料が凄い。自然言語処理の基礎知識やGPTモデル、今後の発展と、かなり噛み砕かれて解説されているので、初心者でも理解しやすい構成になってる。 こちら👇 speakerdeck.com/kyoun/llm-intr…

自然言語処理(LLM)まわりの最近の動向、この資料がよくまとまってそう(まだ読んでない) 今年6月下旬の資料だからまだ鮮度も良さげ speakerdeck.com/ikuyamada/da-g…

LLMは人が学習可能な言語もそうでない言語も同様に学習できるから、LLMを研究しても人の言語について何も教えてくれないという主張がされているが、本当にそうかは示されてなかった。人が学習不可能な言語を設計しLLMに学習させるとLLMも学習が難しいことがわかった arxiv.org/abs/2401.06416…

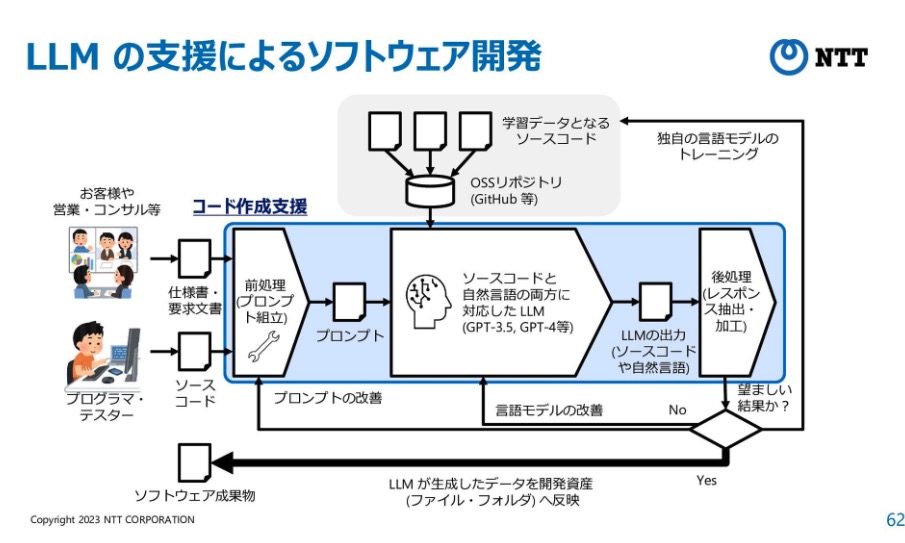

NTTが公開した「大規模言語モデルとそのソフトウェア開発に向けた応用」の資料が凄い。LLMとは何かという基礎的な内容から始まり、開発へどのように応用させるのかが具体例と共にわかりやすく解説されている。 こちら👇 speakerdeck.com/kazato/da-gui-…

東工大学が公開した「大規模言語モデル」の資料が有益なので共有。LLMについて基礎から応用的な内容まで、図解と共にわかりやすく解説している。 こちら👇 speakerdeck.com/chokkan/llm?sl…

speakerdeck.com

大規模言語モデル

2023年度統計関連学会連合大会チュートリアルセッション 言語モデルと自然言語処理のフロンティア

Transformer-Lite High-efficiency Deployment of Large Language Models on Mobile Phone GPUs The Large Language Model (LLM) is widely employed for tasks such as intelligent assistants, text summarization, translation, and multi-modality on mobile phones. However, the current

In our new preprint, we ask: Do multilingual LLMs trained mostly on English use English as an “internal language”? - A key question for understanding how LLMs function. “Do Llamas Work in English? On the Latent Language of Multilingual Transformers” arxiv.org/abs/2402.10588

中国語で開発されたLLMの日本語能力が強いことがクローズアップされている。日本語史を研究している立場から考えると、日本語には、長い漢文訓読の営為からの知識や思考法が大量に取り入れられているためではないかと思う。だから、漢文の深い知識に優れたモデルは、日本語も深く解釈可能な気がする。

この @karpathy 先生によるLLM入門、わかりやすいのでおすすめ。英語が苦手でもCC字幕を表示すれば何とかなるので、日本語の解説を100本見るよりもこの動画1本を流し見するほうが良いです。 youtube.com/watch?v=zjkBMF… 学習=インターネット全体を圧縮したファイルの生成、という表現が良いですね!

一般公開されている日本語LLMのリスト。網羅性はないと注意書きがなされていますが、非常に多くのモデルをリストアップされていて参考になります。 Embeddings作成に特化したモデルもたくさんあるんだなぁということを初めて知りました😇 (小並感) github.com/llm-jp/awesome…

I am once again asking ESL companies to tone down the blatant racism underlying what they consider a "native English speaker"

My activities during language "maintenance mode" 📚 Reading short stories 🔊 Tons of podcasts & music 🗨️ Talking to lang partners or friends 🐦 Tweeting & reading tweets in the TL 📰 Reading articles 🎥Watching movies with subtitles in the TL 🔍Using a monolingual dictionary

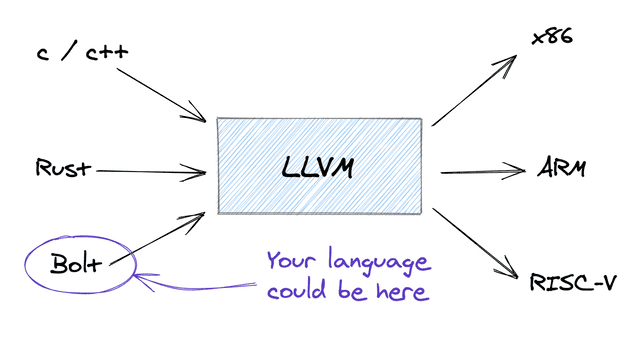

A Complete Guide to LLVM for Programming Language Creators mukulrathi.co.uk/create-your-ow…

A Complete Guide to LLVM for Programming Language Creators mukulrathi.co.uk/create-your-ow…

🌏 2021 Languages Thread 🇵🇭🇭🇺🇰🇷🇯🇵🇫🇷🇹🇼🇲🇽🇻🇳 I am taking a quarterly approach to language goalsetting in 2021. This thread will be updated every 3 months with focus & maintenance languages, checklists and mindsets 💕🤓

Something went wrong.

Something went wrong.

United States Trends

- 1. Paramount 46K posts

- 2. #CHILISSKILLETQUESO N/A

- 3. #IDontWantToOverreactBUT 1,453 posts

- 4. #GoldenGlobes 98.6K posts

- 5. Kyle 31.4K posts

- 6. Go Birds 4,486 posts

- 7. NextNRG Inc. 1,869 posts

- 8. #MondayMotivation 12.5K posts

- 9. Harada 15K posts

- 10. Victory Monday 3,089 posts

- 11. #NextNRG_FoodGridRescue N/A

- 12. Tekken 34.3K posts

- 13. JUST ANNOUNCED 15.8K posts

- 14. Crockett 19.8K posts

- 15. Good Monday 58.7K posts

- 16. John Lennon 16.1K posts

- 17. Talarico 6,691 posts

- 18. Will Hall 5,703 posts

- 19. Immaculate Conception 20.6K posts

- 20. Allred 2,335 posts