変化 hEnka

@hEnka_robotics

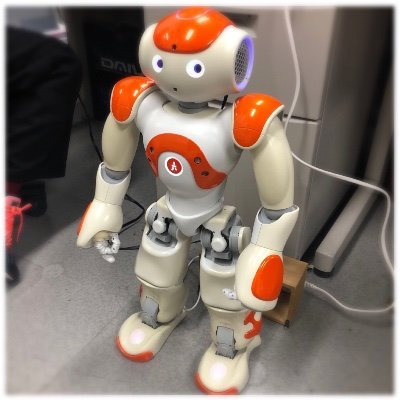

電気通信大学 / University of Electro-Communications 自律移動 脚ロボの強化学習 アームの模倣学習 / SLAM&Nav, Reinforcement learning for legged robots, Imitation Learning for robot arms

Anda mungkin suka

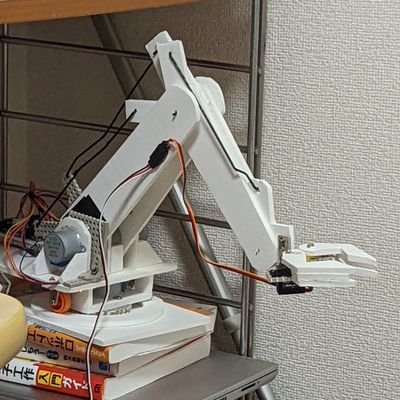

初めの一歩!! The First Step!! @pizac__様と共同開発です

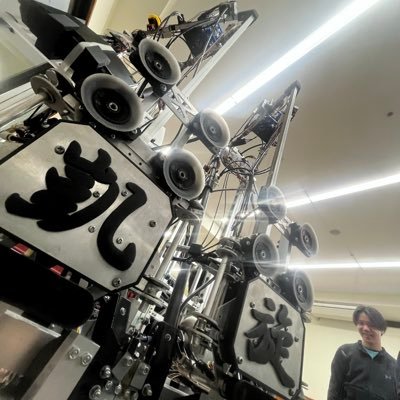

明日12月3日から6日まで開催される国際ロボット展に参加しています。場所は国際展示場東5-33です。 今回は、プラレールの分解、ベルトコンベアのピック&プレース、パンケーキのひっくり返し、の3点を用意しています。#国際ロボット展 #irex2025 #iREX

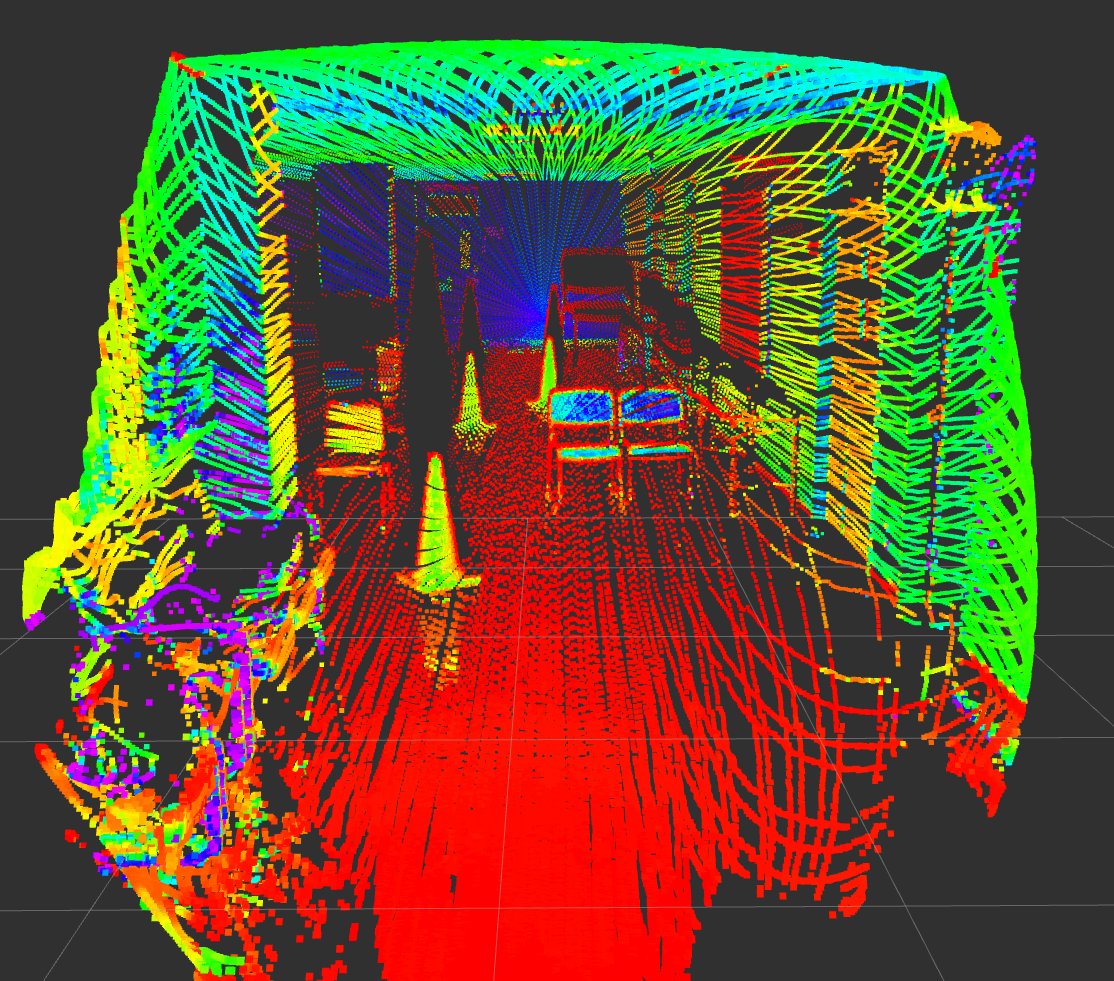

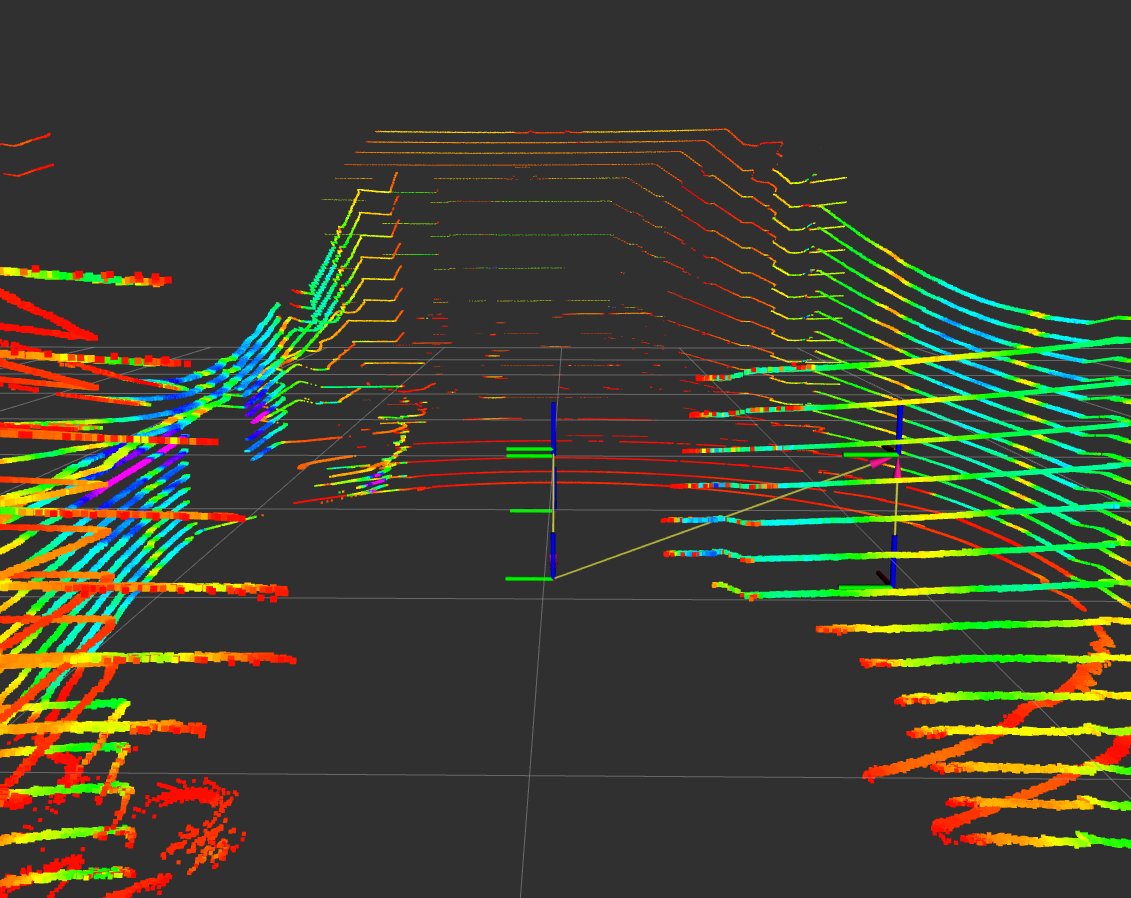

velodyne vlp-16君流石にスパースすぎないか? 回転式だからしゃーないけど

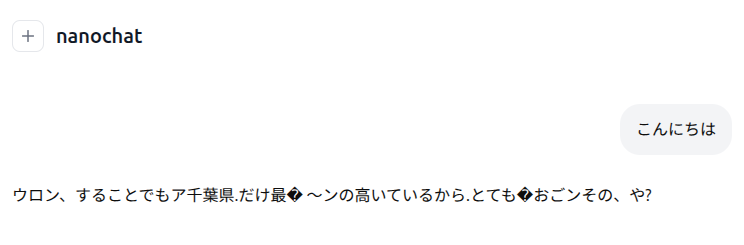

DGX SparkでゼロからLLM学習、日本語でチャレンジしてみました。まずは10epochで動作確認。だいぶかしこい

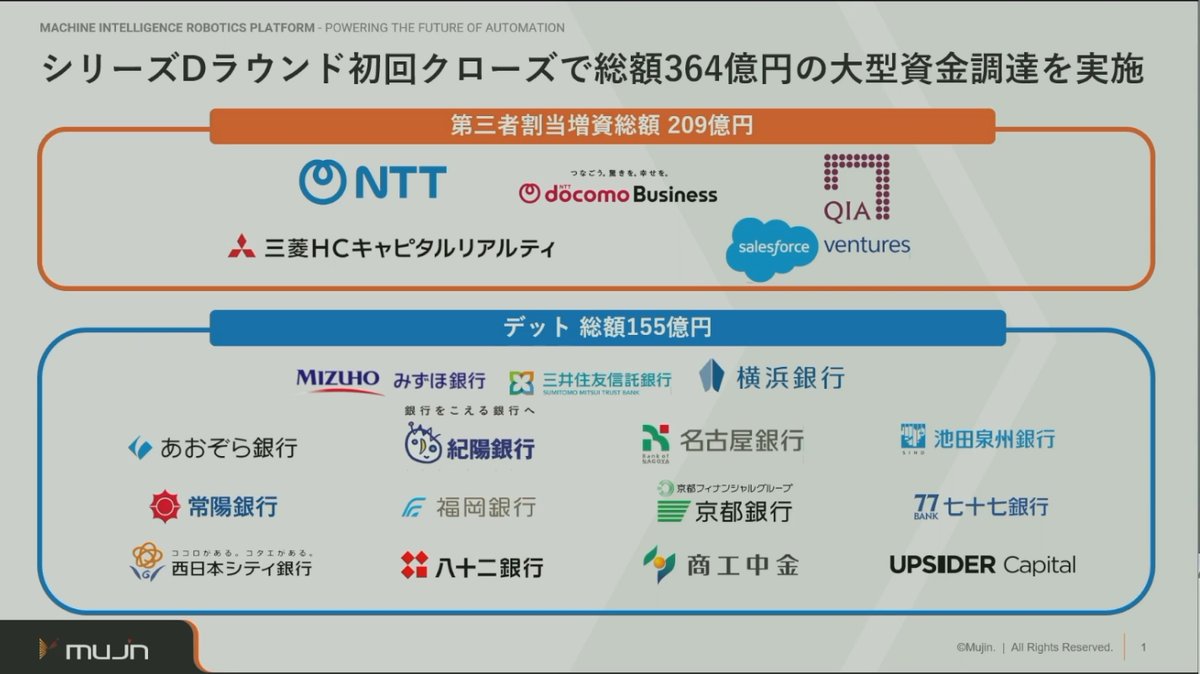

Mujin 2025年 国内最大級の資金調達を発表です。

車もない、GPUもない、開発拠点もない、何もないところからオールチューリングでここまで来たんだよなぁと。 ウサギが前にいることはカメがゴールを目指さない理由にはならない。素敵な勘違いで世界を変える。このチューリングマインドが私は好きなので、これからも頑張りたい。

東京をe2eモデルで30分走るモデルができました! チューリングは指数関数的成長の爆発の手前にいます!

Turingのデモすごすぎます!!

東京をe2eモデルで30分走るモデルができました! チューリングは指数関数的成長の爆発の手前にいます!

明日から開催される国際ロボット展のナブテスコ様ブース内でアーカックスを展示します。お時間ある方は、ぜひお越し下さい。 1時間毎に動作デモを実施予定です。 ・会期 2025/12/3(水)~ 12/6日(土) ・時間 10:00 ~ 17:00 ・会場 東京ビッグサイト ・ブース 西2ホール W2-33…

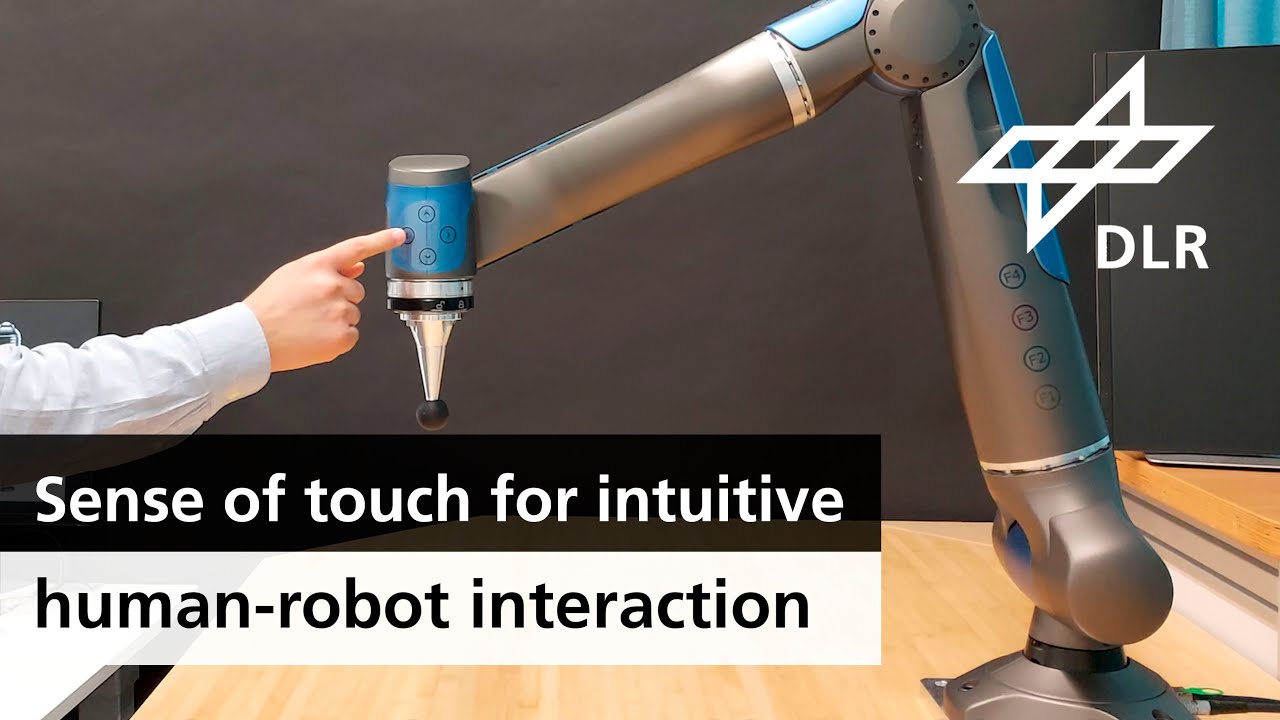

やっぱこれエグすぎるよ youtu.be/rgoKUmdIRnU?si…

youtube.com

YouTube

Sense of touch for intuitive human robot interaction

です🙂 資金調達したのでがっつり4足歩行ロボットと人型ロボットの開発に取り組めます💪

東京をe2eモデルで30分走るモデルができました! チューリングは指数関数的成長の爆発の手前にいます!

Alibaba's RynnVLA-002: A Unified Vision-Language-Action & World Model This novel framework combines robot action generation with environment dynamics prediction, achieving 97.4% success on LIBERO simulation & a 50% boost in real-world LeRobot tasks.

授業でもし戦争が起きて徴兵が始まったら的な話題になってたので,もしワイが徴兵されたらぶっ壊れたドローンとか機材の整備をするような前線の手前の兵になるのかな...

United States Tren

- 1. #GivingTuesday 24.3K posts

- 2. #twitchrecap 6,422 posts

- 3. Larry 36.8K posts

- 4. Costco 49.5K posts

- 5. Jared Curtis 2,672 posts

- 6. #DragRace 5,277 posts

- 7. #AppleMusicReplay 8,636 posts

- 8. So 79% 1,375 posts

- 9. Susan Dell 5,924 posts

- 10. Cabinet 54.4K posts

- 11. NextNRG Inc. 2,943 posts

- 12. #SleighYourHolidayGiveaway N/A

- 13. Carton 29.5K posts

- 14. WFAN N/A

- 15. King Von 1,766 posts

- 16. BT and Sal N/A

- 17. Lucario 26.5K posts

- 18. Punk and AJ 2,077 posts

- 19. Trump Accounts 13K posts

- 20. Tiki 2,896 posts

Anda mungkin suka

Something went wrong.

Something went wrong.