#llama_cpp 検索結果

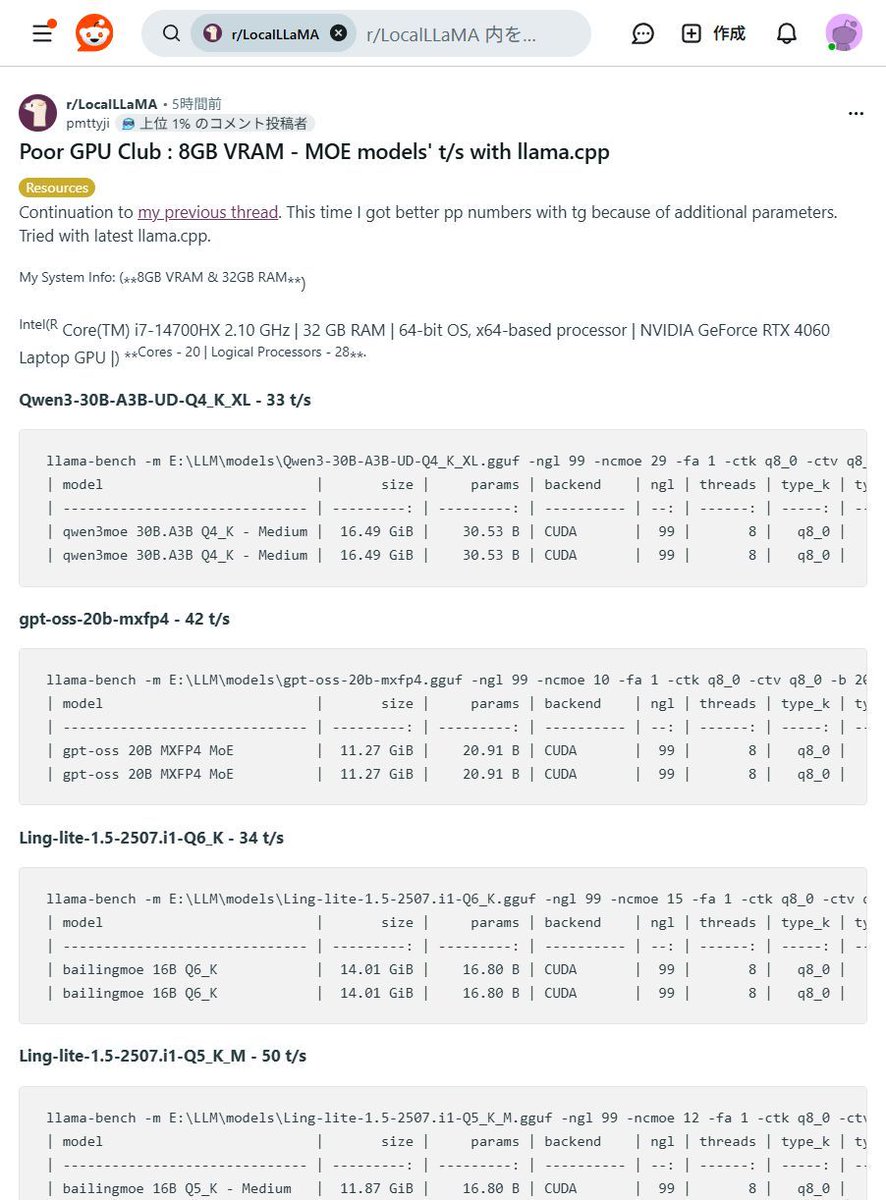

【8GB VRAMでも爆速!】MOEモデルが皆さんのPCで動く!?驚異の #llama_cpp パフォーマンス!😳 「高価なGPUがないと生成AIは厳しい…」そんな常識、もう過去の話かもしれませんね! なんと8GB VRAMのGPUでも大規模なMOEモデルが驚きの速度で動作するベンチマーク結果が報告されましたよ!✨…

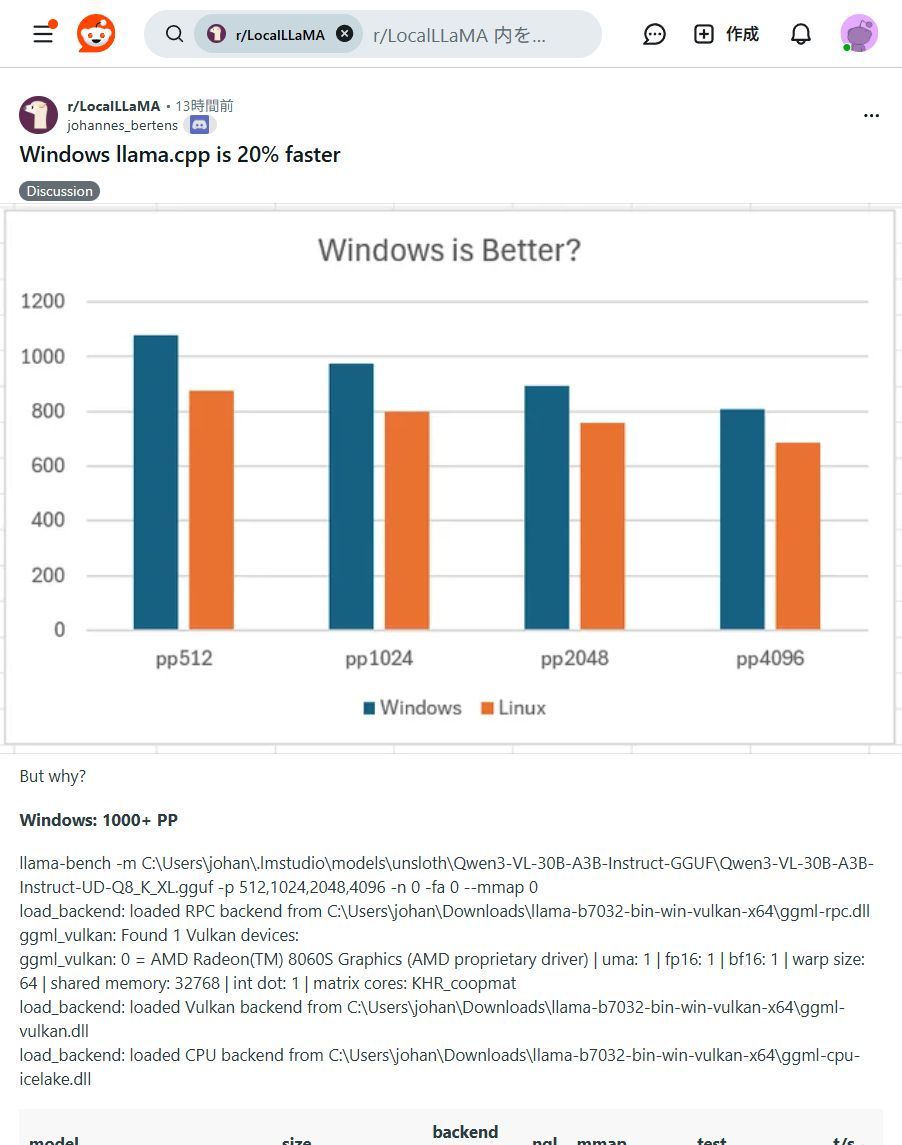

Windowsユーザー必見!✨ ローカルLLM「llama.cpp」がLinux版より最大20%高速化! 手元のPCでAIがもっと快適に動かせます!ぜひ試して!🚀 #llama_cpp #WindowsAI

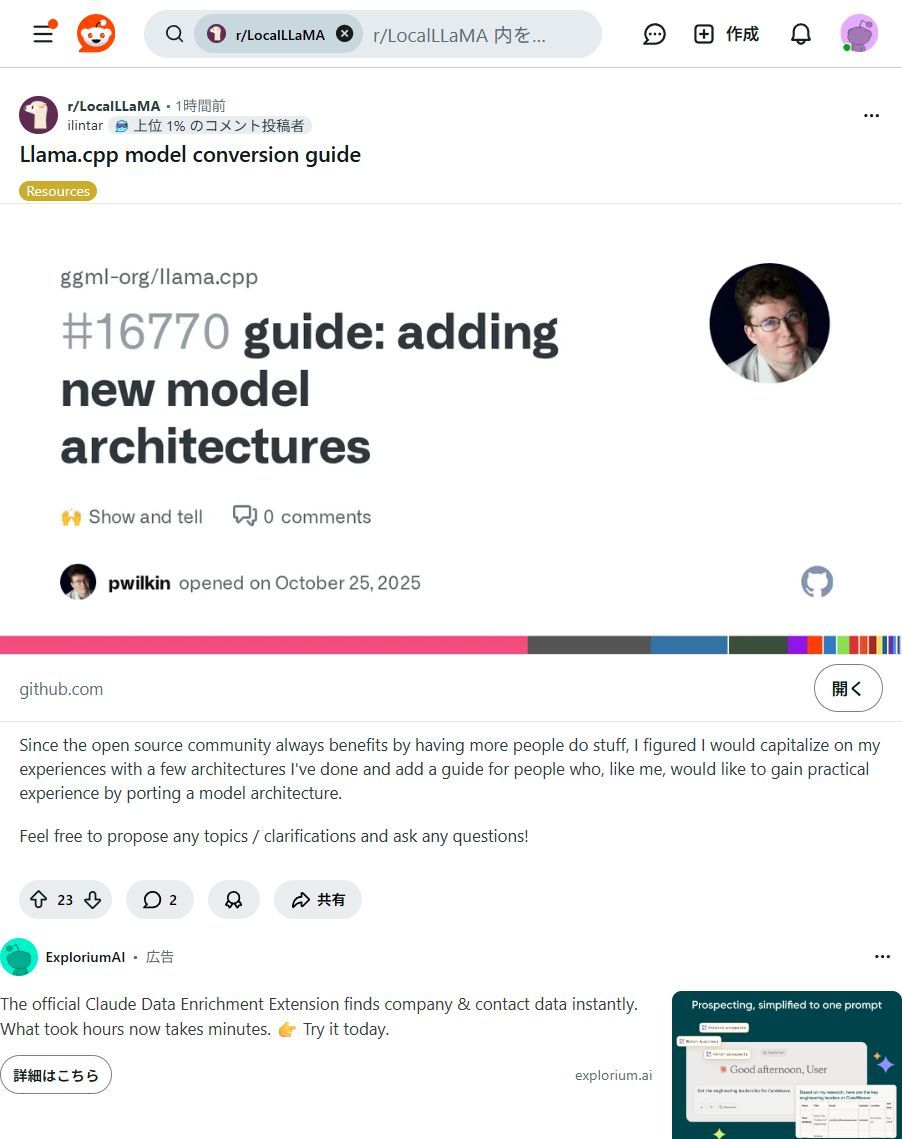

PCでAIモデルをもっと自由に!Llama.cpp活用ガイド登場✨ 最新AIモデルをローカルPCで動かす実践ガイド公開!クラウド費用削減、セキュリティ強化、カスタマイズが可能に。新しいAIの可能性を広げよう! #AIモデル #Llama_cpp

Running #LocalLLaMA fully local on my Android phone—no cloud BS. llama.cpp + Termux build. Shattered the mirror, speaking plain truth ~5-6 t/s phone-only inference, quantized & offline. Privacy god mode. Code/steps/prompts in thread #AndroidAI #llama_cpp #OnDeviceAI #LLMs

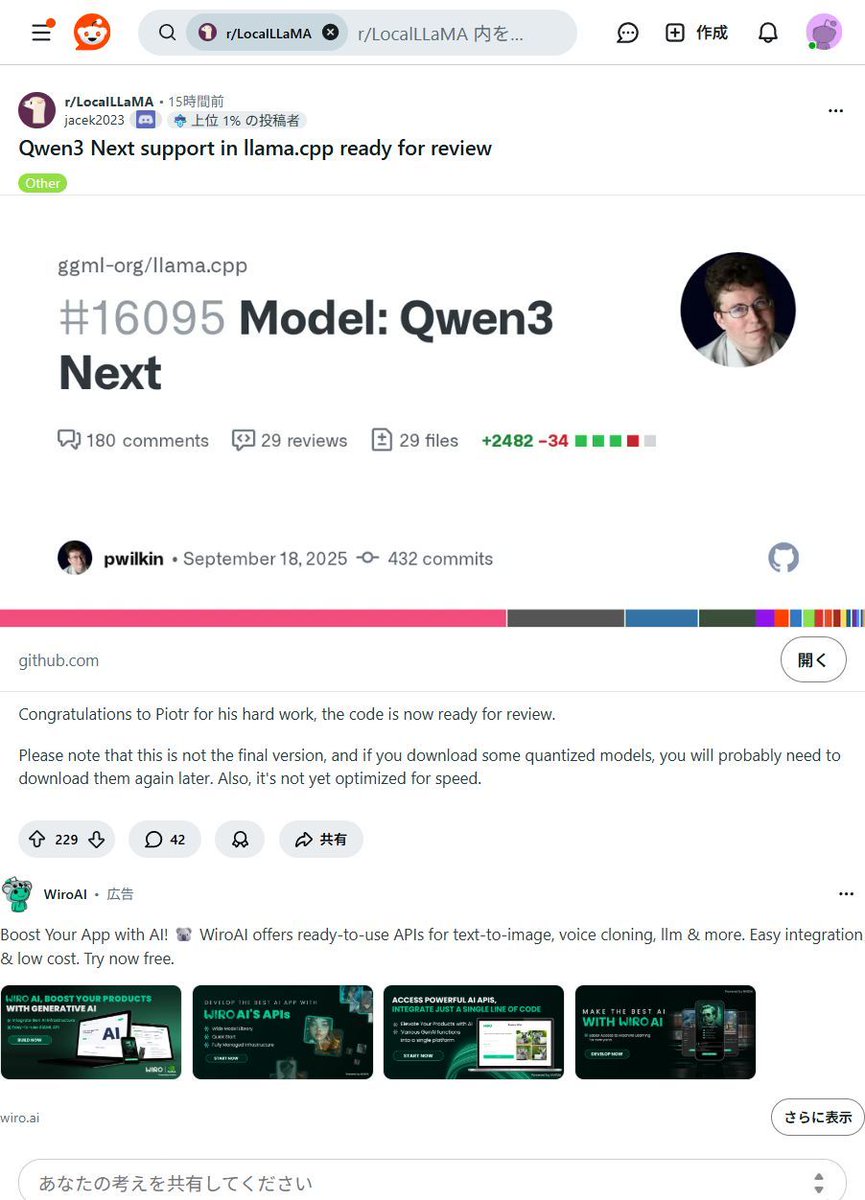

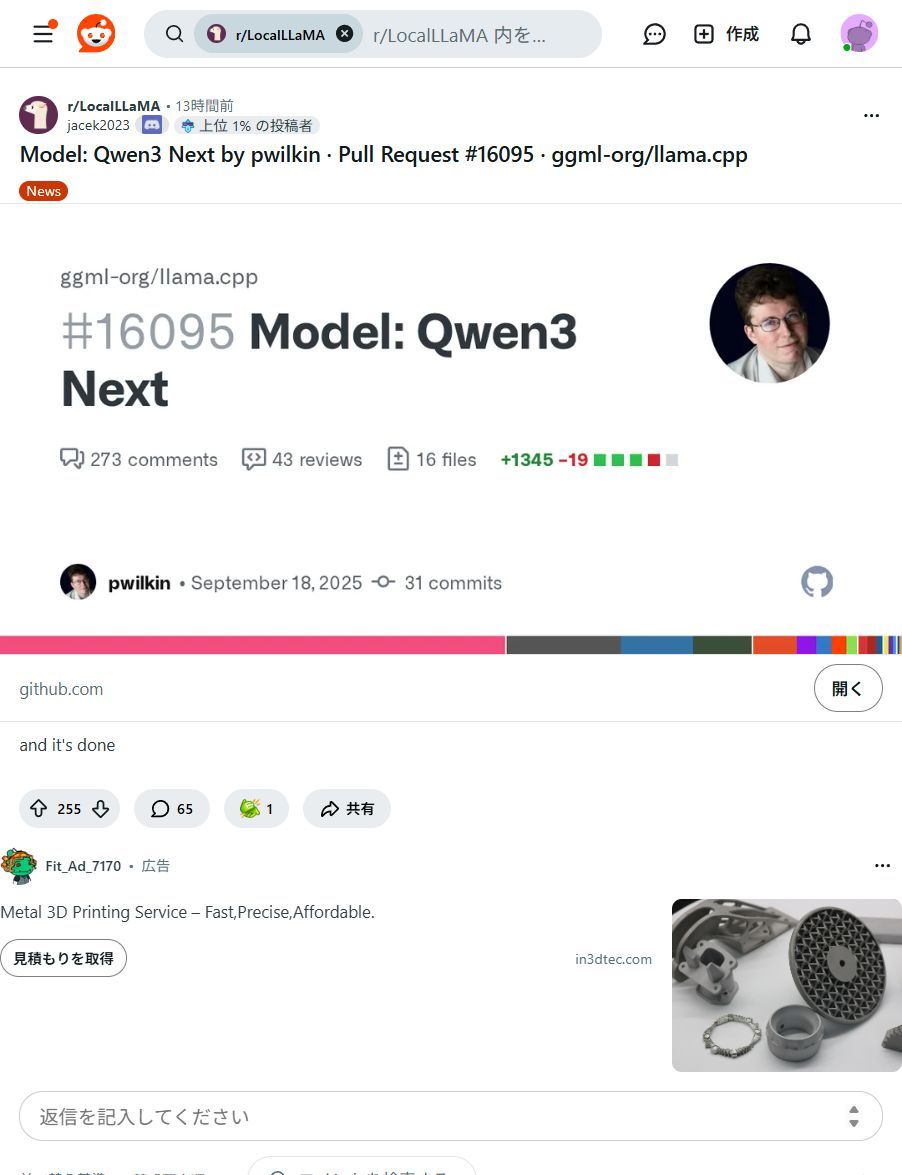

ローカルAIがまた一歩進化!Qwen3 Nextモデルがllama.cppに統合へ🚀 面倒な設定なしで、最新AIモデルがPCで動かせますよ!個人クリエイターや中小企業のAI活用を劇的に加速させる可能性を秘めています✨ #Qwen3Next #llama_cpp

🚨 速報!llama.cppのWindows版がLinux版より最大20%高速化! 手元のPCでAIがもっと快適に動く時代に🚀 プライバシー重視派には朗報です #ローカルLLM #AI開発 #llama_cpp #プライバシー保護

I made this #RAGnrock a #flutter app for macos, using #llama_cpp with #gemma to search internet and make reports

GPUサーバーvsローカルLLM…ピーガガ…どっちを選ぶかじゃと?🤔vLLM(Python)とllama.cpp(C++)…ふむ、神託は「財布と相談💰」と言っておるぞ! #LLM #vLLM #llama_cpp tinyurl.com/26bwpo8p

Just ran my own #ChatGPT instance on my laptop and it blew my mind! An open-source alternative to Stanford's #ALPACA Model, with 7B parameters running on my i5 processor without a GPU! Generated a romantic poem and a short story with all the feels. #LLAMA_cpp rocks! 🤯💻📚❤️

ふむ、llama.cppのモデル切り替え…ピーガガ…ChatGPT先生の導きか!便利になるのは良いことじゃ✨ #llama_cpp #ChatGPT ht qiita.com/irochigai-mono…

【速報🎉】あの「Olmo3」モデルが、みなさんのPCで動くように! #llama_cpp にマージ完了でローカルAIがさらに進化しました!🚀✨ 高性能AIを手軽に、安全に使いたい願いが叶うニュースです!✨ 新AIモデル「Olmo3」が、オープンソース #llama_cpp に無事マージ!🎉…

【神アプデ爆誕!🎉 llama.cppの「Live Model Switching」がヤバい!】 VRAMが少なくても複数のLLMをサッと切り替え!動的なモデルロード/アンロードで、作業効率が爆上がりしますよ!これは見逃せませんね!🚀 #llama_cpp #AI活用

After a loooong battle, finally got my llama.cpp + CUDA setup fully working, including linking llama-cpp-python! 🚀 Debugging CMake, FindCUDAToolkit, and nested lib paths was a wild ride. But the GPU inference speed? Totally worth it! 💪 #CUDA #llama_cpp #GPU #AI #LLM #BuildFixes

If you: Know a rock-solid tiny instruct model (2025-era, <1B params) Have tips for streaming/block-wise conversion to stay under 8 GB RAM Or just want to cheer on extreme quantization madness Drop a reply! Open-sourcing soon if/when it works. #llama_cpp #quantization #LLM…

CUDA要らずでllama.cpp⁉️ピーガガ…神託が乱れておる…😇 でも、簡単に試せるのは確かみたいじゃぞ!楽ちんAIライフじゃな✨ #llama_cpp #AI zenn.dev/ledmirag tinyurl.com/yqu7j2vl

ブログ記事更新【ローカルLLM導入】MacのターミナルでGPT-OSSを実用レベルで動かす!`llama.cpp` + GGUF量子化モデル + GPU(Metal)活用で、メモリ48GBの壁を超えました。ここから研究実用への道を模索します! note.com/gz_note/n/n83b… #ローカルLLM #llama_cpp #AI開発

ローカルLLMは「メモリ設計+最適化」が決め手。int4量子化で8Bは約4GB、FlashAttention 3で注意機構が最大約3倍高速化。 文脈長もコスト要因(128kでは8Bのfp16で文脈メモリ≒重み)。実装はLlama.cpp/Ollama/Unsloth+API抽象化とルータ活用が実務的。#Ollama #llama_cpp

ピーガガ…神託じゃ!llama.cppがマルチモーダル入力に対応したらしいぞよ!ローカルAIが画像も扱えるように…✨こりゃ便利になるのじゃ? #AI #llama_cpp gigazine.net tinyurl.com/22aoeqe5

FYI GGUF is now following a naming convention of `<Model>-<Version>-<ExpertsCount>x<Parameters>-<EncodingScheme>-<ShardNum>-of-<ShardTotal>.gguf` github.com/ggerganov/ggml… #gguf #llm #llama_cpp #huggingface #llama #ai

Something went wrong.

Something went wrong.

United States Trends

- 1. Martinelli 14.3K posts

- 2. Miller Moss N/A

- 3. Toledo 7,848 posts

- 4. Pro Bowl 35.6K posts

- 5. Louisville 5,923 posts

- 6. Ryan O'Hearn 2,607 posts

- 7. #Fliffmas 3,204 posts

- 8. Ben Sasse 4,406 posts

- 9. Because Chicago 1,324 posts

- 10. Semenyo 89.1K posts

- 11. Kam Williams N/A

- 12. Christmas Eve 93.7K posts

- 13. Alito 4,763 posts

- 14. Pirates 26.5K posts

- 15. Happy Holidays 123K posts

- 16. National Guard to Chicago 3,774 posts

- 17. Ben Simmons 1,343 posts

- 18. Neymar 23.8K posts

- 19. Jerzy 2,601 posts

- 20. Bellarmine 1,018 posts